-

Tennis: Sinner da record, è il più giovane finalista in tutti i Masters 1000

Tennis: Sinner da record, è il più giovane finalista in tutti i Masters 1000

-

Trump alza i dazi sulle auto Ue al 25%

-

'I droni a scuola contro le sparatorie di massa, l'esperimento in Florida'

'I droni a scuola contro le sparatorie di massa, l'esperimento in Florida'

-

Tennis: il francese Fils battuto in due set, Sinner in finale a Madrid

-

Calcio: il Venezia pareggia a La Spezia 2-2 e torna in Serie A

Calcio: il Venezia pareggia a La Spezia 2-2 e torna in Serie A

-

Mourinho smentisce i contatti con il Real Madrid 'nessuno mi ha parlato'

-

Tare sul rinnovo di Modric "secondo me resterà ancora con il Milan"

Tare sul rinnovo di Modric "secondo me resterà ancora con il Milan"

-

Arisa dà il via al Concertone con un omaggio a Dalla

-

Cristiano Ronaldo 'la fine della mia carriera si avvicina,godiamoci ogni partita'

Cristiano Ronaldo 'la fine della mia carriera si avvicina,godiamoci ogni partita'

-

Amsterdam oscura la pubblicità di attività che alimentano la crisi climatica

-

Dosso, 'Il calcio? Finalmente si parla di atletica'

Dosso, 'Il calcio? Finalmente si parla di atletica'

-

Araghchi, 'Pentagono mente, la guerra in Iran costata agli Usa 100 miliardi'

-

Mondiali: prezzi biglietti esorbitanti, la Fifa rivedrà sua politica per edizione 2030

Mondiali: prezzi biglietti esorbitanti, la Fifa rivedrà sua politica per edizione 2030

-

Primo Maggio, sono partiti in migliaia in corteo a Torino

-

Media, sbarcati a Creta gli attivisti della Flotilla intercettati da Israele

Media, sbarcati a Creta gli attivisti della Flotilla intercettati da Israele

-

Svelate le stelle per Emily Blunt e Stanley Tucci sulla Walk of Fame

-

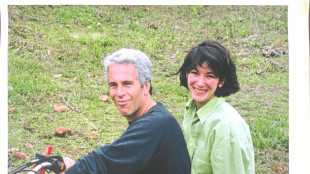

'Biglietto d'addio di Epstein nel fascicolo giudiziario dell'ex compagno di cella'

'Biglietto d'addio di Epstein nel fascicolo giudiziario dell'ex compagno di cella'

-

Hegseth, 'è fondamentale modernizzare la triade nucleare'

-

Sarà Andreeva-Kostyuk la finale femminile del Wta 1000 di Madrid

Sarà Andreeva-Kostyuk la finale femminile del Wta 1000 di Madrid

-

Conference League: vincono Crystal Palace e Rayo Vallecano

-

Europa League: al Forest il derby inglese, il Braga batte il Friburgo

Europa League: al Forest il derby inglese, il Braga batte il Friburgo

-

Calcio: Infantino ufficializza che si ricandiderà alla presidenza Fifa

-

Il Lucas Museum a Los Angeles è pronto, l'inaugurazione il 22 settembre

Il Lucas Museum a Los Angeles è pronto, l'inaugurazione il 22 settembre

-

Cobolli battuto da Zverev, il tedesco in semifinale a Madrid

-

Eataly, Cipolloni lascia, un nuovo ad per seconda fase crescita

Eataly, Cipolloni lascia, un nuovo ad per seconda fase crescita

-

Camera Usa vota i fondi per la Sicurezza interna, shutdown verso la fine

-

F1: Antonelli, 'noi con piccole modifiche, gli avversari si avvicineranno'

F1: Antonelli, 'noi con piccole modifiche, gli avversari si avvicineranno'

-

Bernini, sostegno dell'Italia all''European Research Council

-

Hegseth, richiesta autorizzazione per Iran? Tregua sospende i 60 giorni

Hegseth, richiesta autorizzazione per Iran? Tregua sospende i 60 giorni

-

Oms simula nuova pandemia ma l'Italia non partecipa all'esercitazione

-

Fondazione Doris entra in Tech Europe

Fondazione Doris entra in Tech Europe

-

Netanyahu, 'attivisti Flotilla sostenitori di Hamas, vedranno Gaza su Youtube'

-

Banksy ricompare con una statua nel cuore di Londra, e sfida l'imperialismo

Banksy ricompare con una statua nel cuore di Londra, e sfida l'imperialismo

-

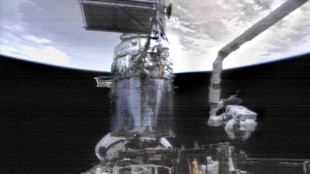

Il telescopio Webb ridefinisce il confine tra stelle e pianeti

-

Peña conferma il sodalizio tra Paraguay e Taiwan con la terza visita in tre anni

Peña conferma il sodalizio tra Paraguay e Taiwan con la terza visita in tre anni

-

Uno Maggio Taranto, prove in corso e attesa per il Concertone

-

I future sul gas chiudono la settimana in calo a 46 euro

I future sul gas chiudono la settimana in calo a 46 euro

-

Lo spread tra Btp e Bund chiude a 82,3 punti

-

Il cantante D4vd accusato di omicidio a Los Angeles, 'uccise per proteggere carriera'

Il cantante D4vd accusato di omicidio a Los Angeles, 'uccise per proteggere carriera'

-

Figc: Malagò 'sostegno di Aic e Aiac mi responsabilizza ulteriormente'

-

Borsa: Europa in rialzo, Londra +1,6%

Borsa: Europa in rialzo, Londra +1,6%

-

Bis di Pogacar al Romandia, altra volata vincente

-

'Aung San Suu Kyi andrà ai domiciliari'

'Aung San Suu Kyi andrà ai domiciliari'

-

Israele, attivisti Flotilla saranno rilasciati in Grecia nelle prossime ore

-

Fan Bingbing premiata al Far East di Udine con il Golden Mulberry

Fan Bingbing premiata al Far East di Udine con il Golden Mulberry

-

Caparezza, 'io spesso in crisi ma fare i concerti mi rende tutto migliore'

-

Dolomiti Energia, investimenti per oltre 324 milioni di euro

Dolomiti Energia, investimenti per oltre 324 milioni di euro

-

Scoperta una nuova specie di ragno dedicata ai Pink Floyd

-

Federcalcio: Abete va avanti, presenterà la candidatura

Federcalcio: Abete va avanti, presenterà la candidatura

-

Figc: Lega Serie A 'convergenza su Malagò importante segnale di unità'

Voce Clonata, Truffa e Pericoli

Negli ultimi anni i criminali hanno scoperto nell’intelligenza artificiale uno strumento potentissimo per rendere più credibili le frodi. Tra le truffe più insidiose c’è la clonazione vocale, un fenomeno che sfrutta software capaci di imitare alla perfezione la voce di una persona nota. Bastano pochi secondi di audio – una semplice risposta al telefono o un frammento di un video pubblicato sui social – e i truffatori possono sintetizzare un messaggio con toni, inflessioni ed emozioni identiche a quelli del soggetto imitato. L’obiettivo è indurre la vittima a compiere azioni impulsive: inviare denaro, condividere codici o fornire dati sensibili a un interlocutore che percepisce come familiare.

Come funziona la clonazione della voce

La clonazione vocale si basa su algoritmi di sintesi vocale e apprendimento automatico. Con pochi secondi di campione audio, il software scompone la voce analizzandone tono, ritmo, accento e respiro, quindi addestra un modello in grado di ricostruire e generare frasi inedite con la stessa impronta sonora. Alcuni strumenti sono così sofisticati da simulare il timbro emozionale della persona imitata. Esistono applicazioni a pagamento, ma ormai sono disponibili anche soluzioni gratuite o a basso costo, accessibili a chiunque sappia navigare in rete. Una giornalista statunitense ha dimostrato che con un audio di 30 secondi e un investimento di 5 dollari è possibile registrare una voce clonata in meno di quattro minuti.

Il processo di frode inizia spesso con chiamate mute: i truffatori telefonano senza parlare per raccogliere un semplice «pronto?» che servirà per addestrare l’algoritmo. Una volta ottenuta la clip audio, preparano uno script convincente – un incidente stradale, un arresto o una rapina – e fanno partire la chiamata con un numero falsificato (spoofing) che appare come quello di un familiare, di un avvocato o della banca. La vittima sente la voce del figlio o del nipote che chiede aiuto urgente e, travolta dall’emozione, segue le istruzioni: consegna contanti, comunica una password temporanea (OTP) o installa software di accesso remoto. In alcuni casi i criminali organizzano la raccolta del denaro tramite corrieri che ritirano pacchi o buste a domicilio.

Esempi e casi reali

Le cronache recenti mostrano che la truffa della voce clonata non è più teoria. Nel luglio 2025 una donna della Florida ha ricevuto una chiamata da chi credeva fosse la figlia incinta. La voce piangente raccontava di un incidente, della perdita del bambino e della necessità di soldi per pagare un avvocato. La madre, in preda al panico, ha consegnato 15 000 dollari a un corriere prima di accorgersi che la figlia era a casa sana e salva. Nel Regno Unito un’azienda energetica ha perso 220 000 euro perché un impiegato ha eseguito un bonifico su richiesta di una voce che imitava quella del direttore generale. Nel 2024 un’ingegneria internazionale ha subìto una frode da 25 milioni di dollari, ingannata da un videochiamata con un dirigente apparentemente reale. Un rapporto dell’Unione Europea indica che una società di Hong Kong ha perso oltre 25 milioni di dollari in un colpo orchestrato con voci e video deepfake.

Non sono solo le imprese a essere colpite. In Arizona una madre ha ricevuto una telefonata con la voce della figlia quindicenne, che implorava aiuto per un rapimento. Mentre la donna parlava con i presunti rapitori, il marito ha contattato la ragazza che era tranquillamente all’allenamento, svelando la truffa. In Italia le forze dell’ordine segnalano un aumento di casi: famiglie anziane ricevono telefonate con voci clonate di figli o nipoti che chiedono denaro per emergenze; per difendersi molte adottano il “codice di famiglia”, una parola segreta da pronunciare in caso di chiamate sospette. Un comandante dei Carabinieri ha precisato che questa tecnica può aiutare ma non sostituisce la prudenza: spesso le vittime condividono inconsapevolmente dettagli personali che rendono più facile l’inganno.

Perché è pericolosa

La clonazione della voce è estremamente pericolosa perché sfrutta un mezzo che istintivamente ispira fiducia: la voce è un dato biometrico legato all’identità e alle emozioni. Quando si sente il timbro di un parente in pericolo, si abbassano le difese razionali e si agisce d’impulso. I truffatori giocano sull’urgenza (“paga subito o andrò in prigione”) e sulla segretezza (“non avvisare nessuno”), elementi che spingono la vittima a seguire le istruzioni senza verifiche. Questo schema funziona anche con i dipendenti aziendali, che non vogliono disattendere gli ordini del capo e autorizzano bonifici ingenti.

Il problema è amplificato dalla diffusione dei dati vocali. Secondo una ricerca internazionale, il 53 % delle persone condivide la propria voce online almeno una volta a settimana, fornendo materiale prezioso per i truffatori. Un’indagine condotta su 7 000 utenti ha rivelato che un adulto su quattro ha subìto o conosce qualcuno colpito da una truffa vocale, e il 70 % degli intervistati non si sente in grado di distinguere una voce clonata da quella reale. Tra chi ha perso denaro, il 36 % ha registrato danni tra 500 e 3 000 dollari, mentre il 7 % ha perso fino a 15 000 dollari. Un rapporto europeo indica che nel 2024 il numero di attacchi deepfake è aumentato del 3000 %, con un attacco rilevato ogni cinque minuti e il 49 % delle aziende intervistate colpite da frodi audio.

Risposte istituzionali

La crescita esponenziale di queste frodi ha spinto istituzioni e autorità a muoversi. Negli Stati Uniti la Commissione federale per il commercio (FTC) ha lanciato una Voice Cloning Challenge per sviluppare soluzioni capaci di distinguere voci umane da cloni, rilevare in tempo reale le manipolazioni e inserire watermark inaudibili che impediscano la clonazione. Sono state premiate tecnologie che attribuiscono un “punteggio di autenticità” alle chiamate e sistemi di autenticazione vocale che includono marcature digitali. A livello europeo, il Parlamento chiede una legislazione contro i deepfake che includa obblighi di trasparenza e consenta ai fornitori di contrassegnare contenuti generati dall’AI. In Italia polizia postale e carabinieri promuovono campagne informative e corsi di educazione digitale, mentre le banche rafforzano il monitoraggio comportamentale delle transazioni sospette. Alcune proposte includono l’introduzione di codici d’emergenza per le chiamate e la possibilità di bloccare in tempo reale i bonifici quando si sospettano frodi.

Come proteggersi

Nonostante i progressi tecnologici, la difesa più efficace resta l’attenzione umana. Gli esperti suggeriscono:

- Verificare l’identità su un canale diverso: se si riceve una richiesta urgente di denaro, chiudere la chiamata e richiamare il familiare o l’azienda usando un numero noto. Non fidarsi del numero sul display, perché può essere falsificato.

- Stabilire una parola di sicurezza condivisa in famiglia. Servirà a confermare l’identità di chi chiama.

- Porre domande personali che solo la persona reale può conoscere, come un dettaglio recente o un ricordo comune.

- Controllare l’impronta vocale: limitare la pubblicazione di audio e video sui social, mantenere profili privati e non rispondere a chiamate sospette con il proprio nome.

- Mai condividere OTP, password o credenziali per telefono, neppure se la voce sembra quella di un parente o di un impiegato della banca.

- Segnalare le chiamate sospette alle autorità competenti e alla propria banca. In caso di frode, bloccare immediatamente carte e account, conservare le prove (numeri, registrazioni) e sporgere denuncia.

Conclusione

La clonazione vocale è una delle forme più inquietanti di frode digitale perché sfrutta l’intelligenza artificiale per imitare le persone a noi più care. Con pochi secondi di audio, i criminali generano messaggi realistici e sfruttano la nostra emotività per estorcere denaro o informazioni. Le vittime, tanto nelle famiglie quanto nelle aziende, si moltiplicano e le perdite si misurano in milioni. La soluzione non può essere solo tecnologica: serve una maggiore alfabetizzazione digitale, un atteggiamento prudente e protocolli di verifica condivisi. Conoscere il funzionamento di queste truffe e riconoscere i segnali d’allarme è il primo passo per non cadere nella rete dell’inganno.

Sali di alluminio: sicuri

Sport: Superare le Disabilità

Normandia: scelta strategica

Esplosione GPL a Roma: i fatti

Niagara: Formazione e Tesla

Il salvataggio di Apollo 13

Sudore: Informazioni utili

Caldo e alluvioni: il legame

Vulc: Dietro le Quinte

Enigma occhi blu svelato

Iran: Assalto a Siti Nucleari