-

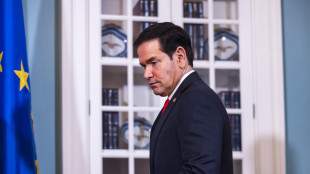

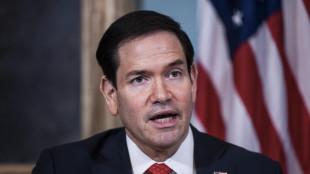

Rubio, 'consulteremo l'Italia sul Libano, può essere molto utile'

Rubio, 'consulteremo l'Italia sul Libano, può essere molto utile'

-

Brasile, l'industria italiana alla Feimec, fiera di macchine leader in America Latina

-

Rubio, 'l'operazione Epic Fury è conclusa, Trump lo ha notificato al Congresso'

Rubio, 'l'operazione Epic Fury è conclusa, Trump lo ha notificato al Congresso'

-

Dario Argento per Metti una sera a cena e docu su De Sica a Cannes Classics

-

Rubio, visita dal Papa pianificata prima dei commenti di Trump

Rubio, visita dal Papa pianificata prima dei commenti di Trump

-

Rubio, 'Project Freedom è difensiva, se sparano per primi risponderemo'

-

Tumore al pancreas, trovata la proteina che lo rende resistente ai farmaci

Tumore al pancreas, trovata la proteina che lo rende resistente ai farmaci

-

A Fano 'Sopravento', il festival diretto da Colapesce e Dimartino

-

Champions: Luis Enrique, a Monaco per vincere ma dovremo dare qualcosa in più

Champions: Luis Enrique, a Monaco per vincere ma dovremo dare qualcosa in più

-

Magyar ricorda Falcone e Borsellino, 'Ungheria ha lottato contro altro tipo di mafia'

-

Concerto-evento dell'Arena di Verona all'Europarlamento di Bruxelles

Concerto-evento dell'Arena di Verona all'Europarlamento di Bruxelles

-

L'organo da Bach al Romanticismo apre rassegna di concerti a Roma

-

Machado mira a elezioni in Venezuela entro un anno e guarda agli Usa

Machado mira a elezioni in Venezuela entro un anno e guarda agli Usa

-

Il prezzo del gas chiude in calo a 47 euro

-

La nave Gaia Blu alla ricerca di faglie sismiche nell'Adriatico

La nave Gaia Blu alla ricerca di faglie sismiche nell'Adriatico

-

Champions: Kompany "non cambieremo approccio, e credo nemmeno loro"

-

Kiev, 'salgono a 12 i morti per un raid russo a Zaporizhzhia'

Kiev, 'salgono a 12 i morti per un raid russo a Zaporizhzhia'

-

Serie A: un turno di squalifica a Tomori, Fadera, Kabasele e Jacobo Ramon

-

Lo spread tra Btp e Bund chiude in calo a 80 punti

Lo spread tra Btp e Bund chiude in calo a 80 punti

-

Definito il decreto attuativo per Transizione 5.0, Urso lo firma

-

Mef, nei primi tre mesi entrate a 131 miliardi, +0,7%

Mef, nei primi tre mesi entrate a 131 miliardi, +0,7%

-

Approvato il bilancio di Principia, utile netto 1,7 milioni

-

Trovato l'interruttore genetico per la riproduzione delle piante

Trovato l'interruttore genetico per la riproduzione delle piante

-

Moto: Andrea Iannone debutta al Mugello nella Harley-Davidson Bagger World Cup

-

Portarono l'arte del mosaico in Australia, la loro storia alla Biblioteca del Senato

Portarono l'arte del mosaico in Australia, la loro storia alla Biblioteca del Senato

-

Cybersicurezza, firmato accordo tra Poligrafico e Guardia di Finanza

-

Il futuro di telecomunicazioni e difesa, focus a Roma

Il futuro di telecomunicazioni e difesa, focus a Roma

-

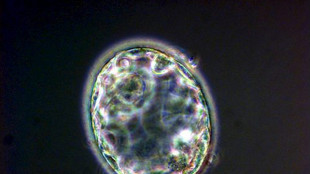

E' battaglia dei sessi nell'ovulo fecondato

-

Tiro a volo: Cdm, oro con record per Rossetti, bronzo per Bartolomei

Tiro a volo: Cdm, oro con record per Rossetti, bronzo per Bartolomei

-

Banca Credito Popolare, Borriello nuovo presidente, Crosta diventa ad

-

In passerella al Met il bianco del marmo e il rosso del sangue

In passerella al Met il bianco del marmo e il rosso del sangue

-

Parkinson, rigidità muscolare da sintomo a 'osservato speciale' per terapie

-

Wall Street apre positiva, Dj +0,27%, Nasdaq +0,90%

Wall Street apre positiva, Dj +0,27%, Nasdaq +0,90%

-

Ecco 'A Tutta Classe' con oltre 3.500 squadre giovanili-scolastiche in Italia

-

Dombrovskis, deroghe Patto? 'Noi raccomandiamo uso flessibilità esistente'

Dombrovskis, deroghe Patto? 'Noi raccomandiamo uso flessibilità esistente'

-

Arera, tariffa gas di aprile per vulnerabili scesa del 7,6%

-

Auto: la Targa Florio n. 110 mezzo della ricerca medica

Auto: la Targa Florio n. 110 mezzo della ricerca medica

-

'Ritratti' e 'Piano sequenza', due docu omaggio al cinema

-

Borsa: Milano sale del 2,2% e brilla in Europa

Borsa: Milano sale del 2,2% e brilla in Europa

-

L'assemblea di Borsa Italiana rinnova il cda, Testa confermato amministratore delegato

-

Diciannovemila presenze al Torino Jazz Festival, annunciate le date 2027

Diciannovemila presenze al Torino Jazz Festival, annunciate le date 2027

-

A Pitti Uomo attesi 720 marchi, 'puntiamo a mantenere la leadership'

-

Italgas chiude il trimestre con oltre 661 milioni di ricavi

Italgas chiude il trimestre con oltre 661 milioni di ricavi

-

Oltre il 90% di agronomi e forestali risulta occupato, più donne e giovani

-

Bdm Banca, utile netto cala a 5,58 milioni nel trimestre, salgono impieghi

Bdm Banca, utile netto cala a 5,58 milioni nel trimestre, salgono impieghi

-

Matematici contro Trump, via la medaglia Fields dagli Usa

-

Da Danilo Rea a Monica Guerritore e Omar Sosa a ''I Concerti nel Parco''

Da Danilo Rea a Monica Guerritore e Omar Sosa a ''I Concerti nel Parco''

-

In Romania passa la mozione di sfiducia, cade il governo

-

Dedicato a Don Minzoni il progetto 'Cantare amantis est' voluto da Riccardo Muti

Dedicato a Don Minzoni il progetto 'Cantare amantis est' voluto da Riccardo Muti

-

Piano City Milano con la 16/a edizione entra nei luoghi della fragilità

La capacità di giudizio dell'IA è solo apparenza

Grandi rischi nel delegare scelte e giudizi agli Llm

La capacità di giudizio dei modelli linguistici come ChatGpt o Gemini è solo apparenza: a dimostrarlo è lo studio guidato da Walter Quattrociocchi, dell'Università Sapienza di Roma, e pubblicato sulla rivista dell'Accademia Nazionale degli Stati Uniti Pnas. Un lavoro che sottolinea i rischi concreti di affidare a questi modelli di Intelligenza Artificiale la delega di fare scelte o prendere decisioni. "Cosa avviene realmente quando chiediamo a un'IA di eseguire una scelta, ad esempio determinare se una notizia del web sia credibile o è piuttosto una fake news?", ha detto Quattrociocchi all'ANSA per raccontare il nuovo studio che ha eseguito una serie di test a gran parte dei più importanti modelli linguisti Llm in circolazione, come ChatGpt, Gemini, Llama, Deepseek e Mistral. Un lungo lavoro che ha messo a confronto umani e IA per capire le differenze di 'ragionamento' dei due. "Quello che abbiamo messo qui molto bene in evidenza è che nonostante i risultati, le IA riconosco infatti molto bene le fake news, il meccanismo che utilizzano non si basa però su riscontri reali ma su una mera capacità di simulare i giudizi. In altre parole, i giudizi formulati dagli Llm sono plausibili ma disancorati dalla realtà fattuale". Una sostituzione della verità con la plausibilità che in un futuro non molto lontano, sottolineano gli autori, potrebbe portare a problemi gravi quando gradualmente daremo sempre più autorevolezza alle capacità degli Llm di gestire azioni o prendere scelte per noi, in totale delega. "Ma questi sistemi sembrano valutare come noi solo perché simulano le tracce del pensiero, non il pensiero stesso", ha aggiunto il ricercatore italiano. "Questo studio - ha concluso - dimostra che ciò che stiamo automatizzando non è il giudizio, ma la sua apparenza".

W.Huber--VB