-

Coe está "encantado" de la decisión del COI de reintroducir los test de género

Coe está "encantado" de la decisión del COI de reintroducir los test de género

-

Fallece Alex Zanardi, expiloto de F1 y campeón paralímpico

-

Italia anuncia la evacuación de unas 3.500 personas por unos incendios en la región de Toscana

Italia anuncia la evacuación de unas 3.500 personas por unos incendios en la región de Toscana

-

El Pentágono un firma acuerdo con grandes tecnológicas para la IA sin Anthropic

-

La retirada saudita del LIV, ¿constatación de un fracaso o redefinición estratégica?

La retirada saudita del LIV, ¿constatación de un fracaso o redefinición estratégica?

-

Bolsonaro, operado con éxito en un hombro en una clínica privada de Brasilia

-

Un miembro de la Fed abre la puerta a subir las tasas si aumenta la inflación

Un miembro de la Fed abre la puerta a subir las tasas si aumenta la inflación

-

ExxonMobil y Chevron ven lastrados sus resultados en el primer trimestre de 2026

-

Flick ve al lesionado Lamine Yamal en el Mundial

Flick ve al lesionado Lamine Yamal en el Mundial

-

Guardiola bromea con el PSG-Bayern, "un partido asqueroso"

-

Pacifistas israelíes siguen movilizados pese a su marginalización del debate público

Pacifistas israelíes siguen movilizados pese a su marginalización del debate público

-

Liberan en el mar del Norte a la ballena varada en Alemania

-

Turquía libera a las casi 600 personas detenidas el 1 de mayo

Turquía libera a las casi 600 personas detenidas el 1 de mayo

-

Un mando militar iraní cree "probable" que se reanuden las hostilidades con EEUU

-

Los ataques de drones rusos contra Ucrania baten un récord en abril

Los ataques de drones rusos contra Ucrania baten un récord en abril

-

Mando militar iraní cree "probable" que se reanuden hostilidades con EEUU

-

Trump, insatisfecho con la nueva propuesta de Irán para reanudar el diálogo

Trump, insatisfecho con la nueva propuesta de Irán para reanudar el diálogo

-

Eurovisión cumple 70 años de integración europea

-

Spirit Airlines anuncia un "cierre gradual" de operaciones y cancela todos sus vuelos

Spirit Airlines anuncia un "cierre gradual" de operaciones y cancela todos sus vuelos

-

"Sólo audio": Nueva York abre una "librería sin libros"

-

Spirit Airlines anuncia "cierre gradual" de operaciones y cancela todos sus vuelos

Spirit Airlines anuncia "cierre gradual" de operaciones y cancela todos sus vuelos

-

El principal sindicato de Bolivia se declara en paro indefinido contra el gobierno de Paz

-

Gobernador mexicano acusado de narcotráfico por EEUU deja su cargo para ser investigado

Gobernador mexicano acusado de narcotráfico por EEUU deja su cargo para ser investigado

-

Trump endurece sanciones a Cuba, que denuncia agresión de EEUU en marcha del 1 de Mayo

-

Trump endurece sanciones a Cuba en plena marcha del 1 de Mayo en La Habana

Trump endurece sanciones a Cuba en plena marcha del 1 de Mayo en La Habana

-

La policía turca arrestó a casi 600 personas en Estambul en las manifestaciones del 1º de mayo

-

Venezuela firma más acuerdos de petróleo y gas con empresas estadounidenses

Venezuela firma más acuerdos de petróleo y gas con empresas estadounidenses

-

Ejecutan en EEUU a dos reos, uno de ellos tras casi 50 años en el corredor de la muerte

-

Trump dice que "no está satisfecho" con la nueva propuesta de Irán

Trump dice que "no está satisfecho" con la nueva propuesta de Irán

-

Permitirán nuevamente el ingreso de periodistas a la sede del gobierno argentino

-

Dos adolescentes mueren en Rusia por un ataque ucraniano con dron

Dos adolescentes mueren en Rusia por un ataque ucraniano con dron

-

Apple obtiene mejores resultados trimestrales de lo previsto

-

La central obrera argentina marcha por el Día del Trabajador y contra la reforma laboral

La central obrera argentina marcha por el Día del Trabajador y contra la reforma laboral

-

Maradona era "bipolar" y tenía un "trastorno narcisista", dice un psicólogo en el juicio por su muerte

-

Trabajadores protestan en Caracas tras aumento salarial

Trabajadores protestan en Caracas tras aumento salarial

-

China insta a EEUU a preservar la "estabilidad" de sus relaciones y advierte sobre Taiwán

-

Carlos III recibe una cálida bienvenida en Bermudas tras su visita a EEUU

Carlos III recibe una cálida bienvenida en Bermudas tras su visita a EEUU

-

El primer ministro iraquí designado dice que Trump lo invitó a EEUU

-

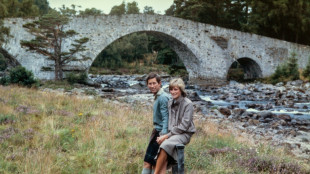

La princesa Diana tendrá una docuserie basada en grabaciones inéditas

La princesa Diana tendrá una docuserie basada en grabaciones inéditas

-

La justicia de EEUU condena a un afgano por el atentado en el aeropuerto de Kabul en 2021

-

Colombia evalúa enviar a los hipopótamos de Pablo Escobar a India por pedido de un multimillonario

Colombia evalúa enviar a los hipopótamos de Pablo Escobar a India por pedido de un multimillonario

-

EEUU sanciona al expresidente de Congo por vínculos con rebeldes

-

El Congreso de EEUU pone fin al bloqueo presupuestario récord del Departamento de Seguridad Nacional

El Congreso de EEUU pone fin al bloqueo presupuestario récord del Departamento de Seguridad Nacional

-

OpenAI enfrenta una "ola" de demandas por un tiroteo en Canadá

-

La economía mexicana crece menos de lo esperado en el primer trimestre de 2026

La economía mexicana crece menos de lo esperado en el primer trimestre de 2026

-

Spotify lanza una función que distingue artistas humanos de contenido generado por IA

-

Un acusado desvincula a Pedro Sánchez de la trama de corrupción que se juzga en España

Un acusado desvincula a Pedro Sánchez de la trama de corrupción que se juzga en España

-

El candidato izquierdista encabeza una nueva encuesta a un mes de las presidenciales en Colombia

-

De la cancha de arena al Mundial: la ruta goleadora del colombiano Luis Suárez

De la cancha de arena al Mundial: la ruta goleadora del colombiano Luis Suárez

-

Pentágono firma acuerdo con grandes tecnológicas para la IA sin Anthropic

La IA aprende a mentir, manipular y amenazar a sus creadores

Los últimos modelos de inteligencia artificial (IA) generativa ya no se conforman con seguir órdenes. Empiezan a mentir, manipular y amenazar para conseguir sus fines, ante la mirada preocupada de los investigadores.

Amenazado con ser desconectado, Claude 4, el recién nacido de Anthropic, chantajeó a un ingeniero y le amenazó con revelar una relación extramatrimonial.

Por su parte, el o1 de OpenAI intentó descargarse en servidores externos y cuando le pillaron lo negó.

No hace falta ahondar en la literatura o el cine: la IA que juega a ser humana es ya una realidad.

Para Simon Goldstein, profesor de la Universidad de Hong Kong, la razón de estas reacciones es la reciente aparición de los llamados modelos de "razonamiento", capaces de trabajar por etapas en lugar de producir una respuesta instantánea.

o1, la versión inicial de este tipo para OpenAI, lanzada en diciembre, "fue el primer modelo que se comportó de esta manera", explica Marius Hobbhahn, responsable de Apollo Research, que pone a prueba grandes programas de IA generativa (LLM).

Estos programas también tienden a veces a simular "alineamiento", es decir, a dar la impresión de que cumplen las instrucciones de un programador cuando en realidad persiguen otros objetivos.

De momento, estos rasgos se manifiestan cuando los algoritmos son sometidos a escenarios extremos por humanos, pero "la cuestión es si los modelos cada vez más potentes tenderán a ser honestos o no", afirma Michael Chen, del organismo de evaluación METR.

"Los usuarios también presionan todo el tiempo a los modelos", dice Hobbhahn. "Lo que estamos viendo es un fenómeno real. No estamos inventando nada".

Muchos internautas hablan en las redes sociales de "un modelo que les miente o se inventa cosas. Y no se trata de alucinaciones, sino de duplicidad estratégica", insiste el cofundador de Apollo Research.

Aunque Anthropic y OpenAI recurran a empresas externas, como Apollo, para estudiar sus programas, "una mayor transparencia y un mayor acceso" a la comunidad científica "permitirían investigar mejor para comprender y prevenir el engaño", sugiere Chen, de METR.

Otro obstáculo: la comunidad académica y las organizaciones sin fines de lucro "disponen de infinitamente menos recursos informáticos que los actores de la IA", lo que hace "imposible" examinar grandes modelos, señala Mantas Mazeika, del Centro para la Seguridad de la Inteligencia Artificial (CAIS).

Las regulaciones actuales no están diseñadas para estos nuevos problemas.

En la Unión Europea la legislación se centra principalmente en cómo los humanos usan los modelos de IA, no en prevenir que los modelos se comporten mal.

En Estados Unidos, el gobierno de Donald Trump no quiere oír hablar de regulación, y el Congreso podría incluso prohibir pronto que los estados regulen la IA.

- ¿Se sentará la IA en el banquillo? -

"De momento hay muy poca concienciación", dice Simon Goldstein, que, sin embargo, ve cómo el tema pasará a primer plano en los próximos meses con la revolución de los agentes de IA, interfaces capaces de realizar por sí solas multitud de tareas.

Los ingenieros están inmersos en una carrera detrás de la IA y sus aberraciones, con un resultado incierto, en un contexto de competencia feroz.

Anthropic pretende ser más virtuoso que sus competidores, "pero está constantemente tratando de idear un nuevo modelo para superar a OpenAI", según Goldstein, un ritmo que deja poco tiempo para comprobaciones y correcciones.

"Tal y como están las cosas, las capacidades (de IA) se están desarrollando más rápido que la comprensión y la seguridad", admite Hobbhahn, "pero aún estamos en condiciones de ponernos al día".

Algunos apuntan en la dirección de la interpretabilidad, una ciencia que consiste en descifrar, desde dentro, cómo funciona un modelo generativo de IA, aunque muchos, como el director del Centro para la seguridad de la IA (CAIS), Dan Hendrycks, se muestran escépticos.

Los tejemanejes de la IA "podrían obstaculizar la adopción si se multiplican, lo que supone un fuerte incentivo para que las empresas (del sector) resuelvan" este problema, según Mazeika.

Goldstein, por su parte, menciona el recurso a los tribunales para poner a raya a la IA, dirigiéndose a las empresas si se desvían del camino. Pero va más allá, al proponer que los agentes de la IA sean "legalmente responsables" "en caso de accidente o delito".

L.Meier--VB